如何部署和使用自己训练的模型

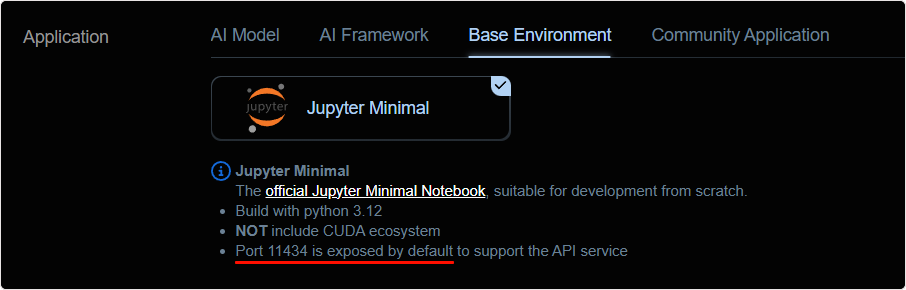

NiceGPU 平台提供的 Jupyter Minimal Notebook 模板里默认开放了 11434 端口,可以借助这个特性来部署和使用自己训练的模型。

注意:这个端口只建议用于 Development 环境,请勿用于生产环境。

详细步骤如下:

1. 创建实例

在 New Instance 界面选择 Base Environment 里的 Jupyter Minimal 模板,创建一个实例,并等待实例创建完成。

2. 训练模型

实例创建完成之后,你可以通过 Compute Connection 里的 Jupter Notebook 按钮打开 Jupyter Notebook 。

然后您可以使用自己的数据和方式训练模型。

3. 使用方式

模型训练完成之后,您只需要在 Jupyter Notebook 里运行您的模型,并且监听 11434 端口。

然后您就可以通过 Compute Connection 里的 Restful API 按钮访问到您的服务了。

注意事项:

- 因为默认只开放了一个端口号,所以您目前只能同时对外提供一个 API 服务。

- 在部署和运行模型之前,请注意机器的资源情况。(如果出现 OOM 等问题,请尝试在

Instance List页面进行Restart操作)- 监听端口的时候,请使用

0.0.0.0IP 地址进行监听,而不是默认的127.0.0.1。

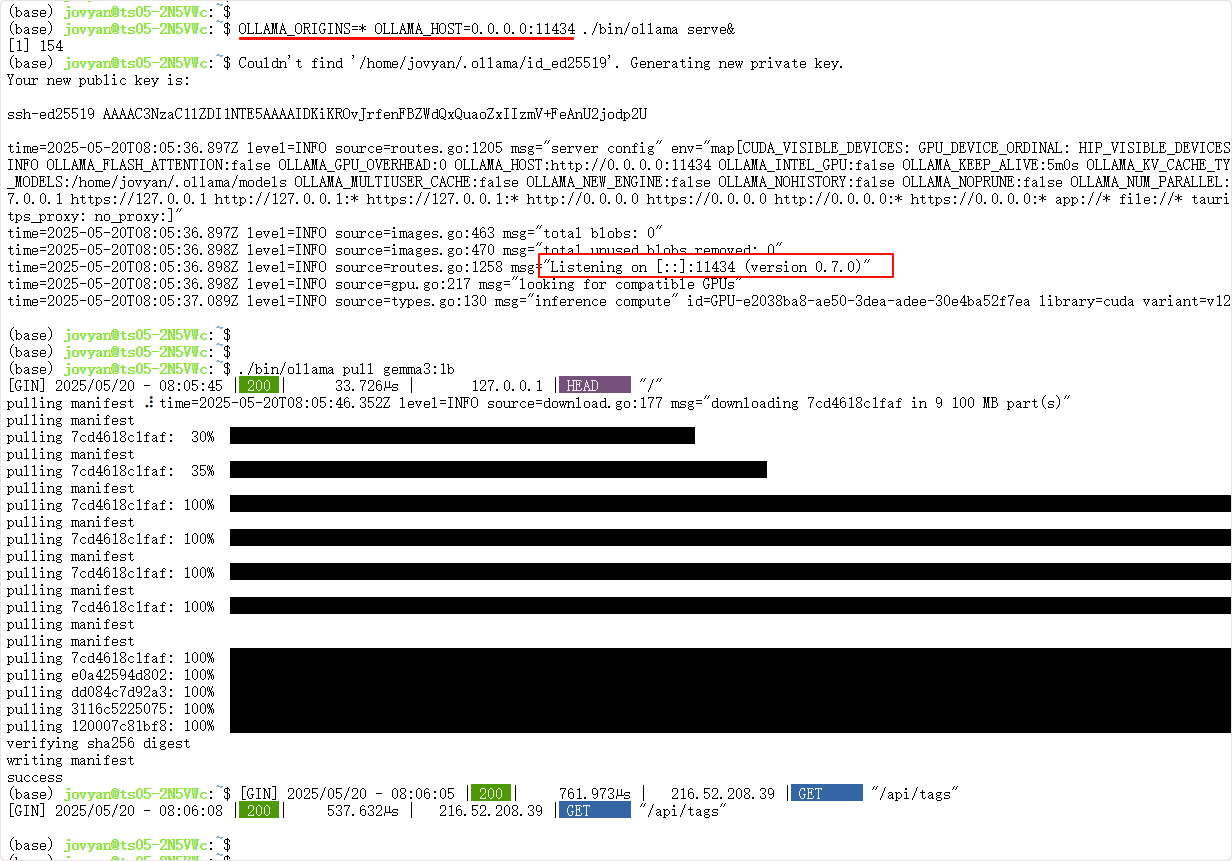

4. 这里使用 Ollama 模型作为示例

下面的命令将下载 Ollama ,并运行一个 gemma3:1b 模型:

curl -fSLO "https://ollama.com/download/ollama-linux-amd64.tgz"

tar -xzf ollama-linux-amd64.tgz

OLLAMA_ORIGINS=* OLLAMA_HOST=0.0.0.0:11434 ./bin/ollama serve&

./bin/ollama pull gemma3:1b

./bin/ollama list

检查服务状态:

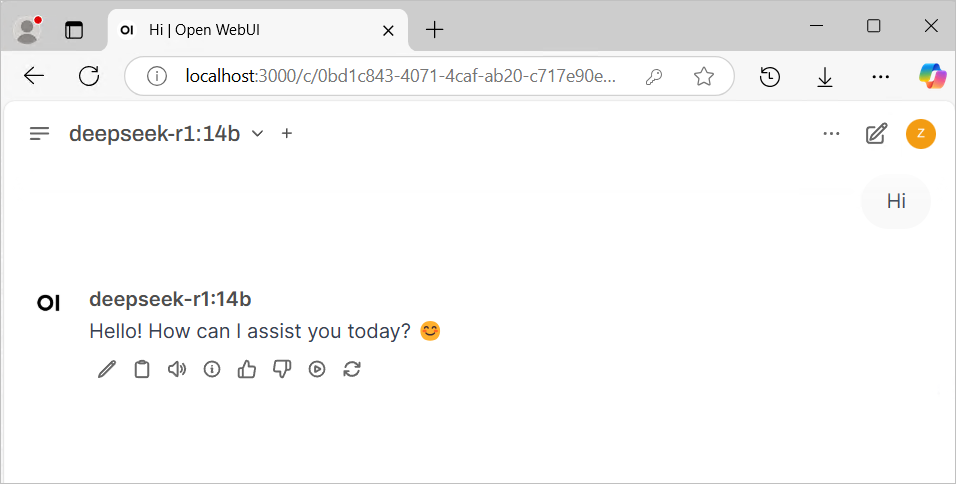

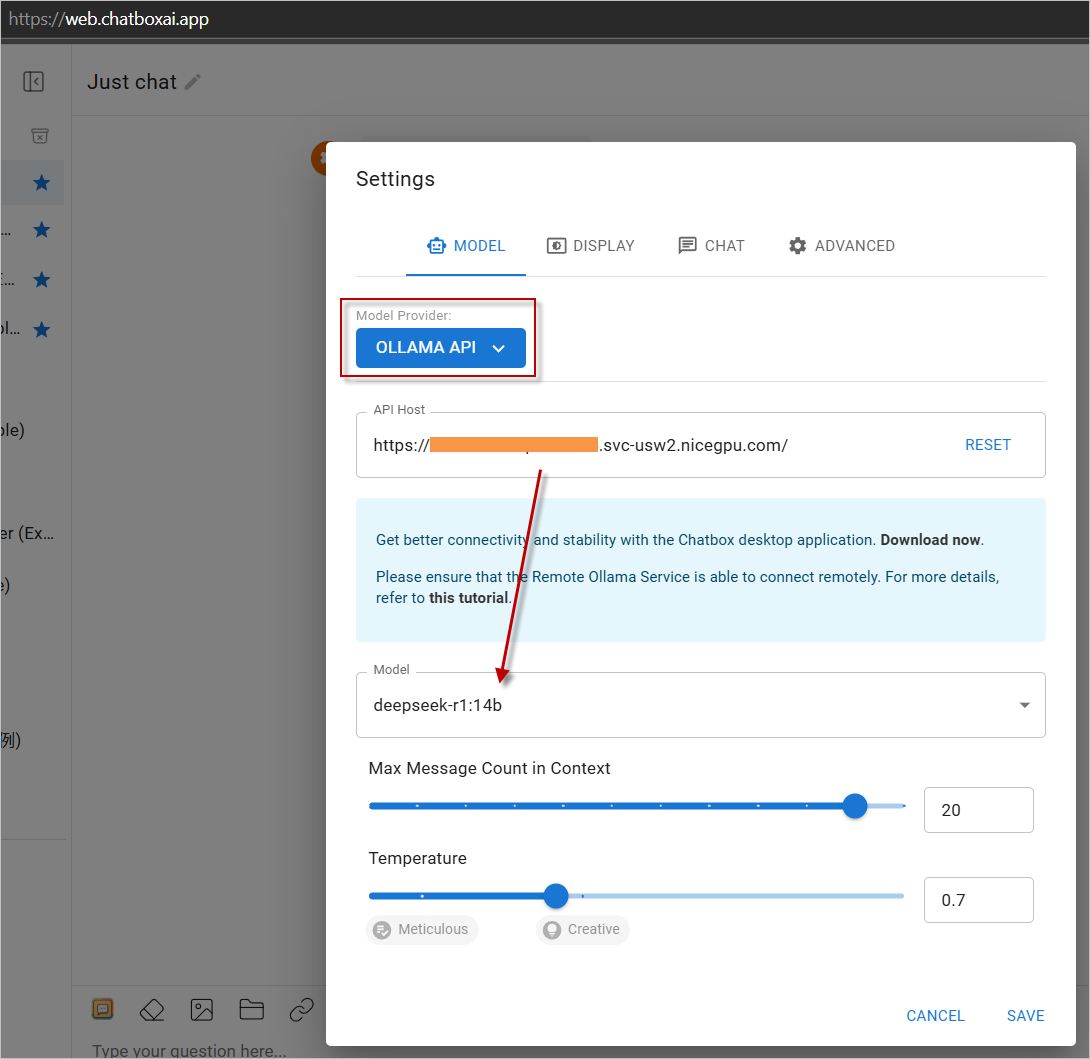

然后通过 Chatbox 或者 Open Web UI 进行调用:

- 下载主流的大语言模型 Web UI 程序,或者使用 Web 版本。

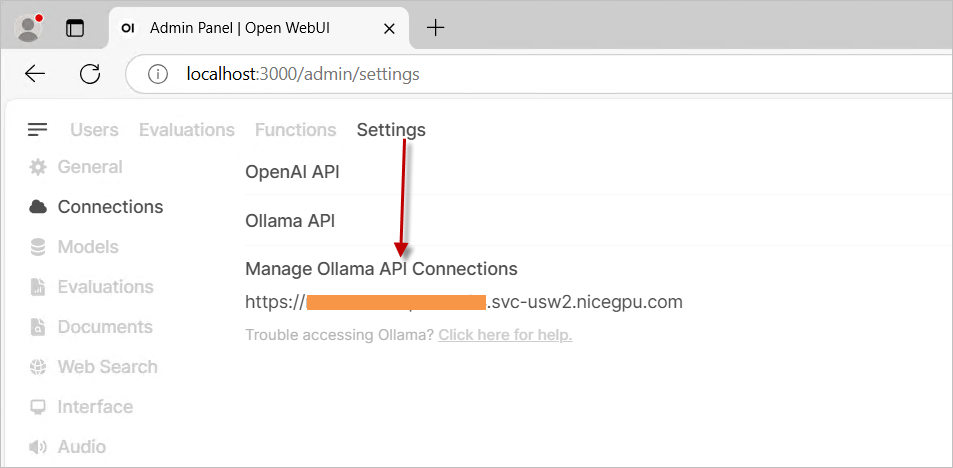

- 在设置里选择

OLLAMA API作为提供者,然后输入您的实例地址。 - 开始使用吧!

点击 https://web.chatboxai.app 使用 Chatbox Web 版本快速尝试:

自行安装 OpenWeb UI 程序,在设置里选择 OLLAMA API 作为提供者,并输入您的实例地址。