快速试用 DeepSeek

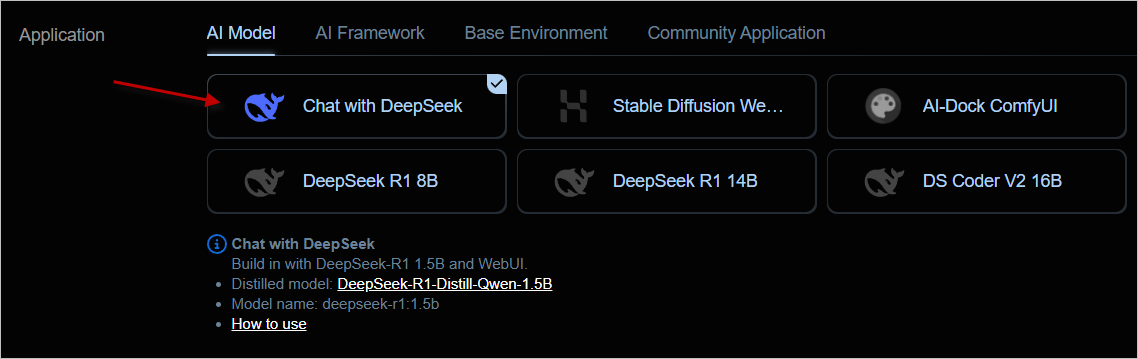

平台提供了一个自带 WebUI 的模板,可以让您快速体验 DeepSeek (以及其他基于 Ollama 模型)的功能。

1. 创建实例

在实例列表里选择第一个 Chat with DeepSeek 模板,然后选择合适的机器创建实例。

这个模板内置的是

deepseek-r1:1.5b模型,几乎所有的机器都能无压力运行。

2. 开始使用

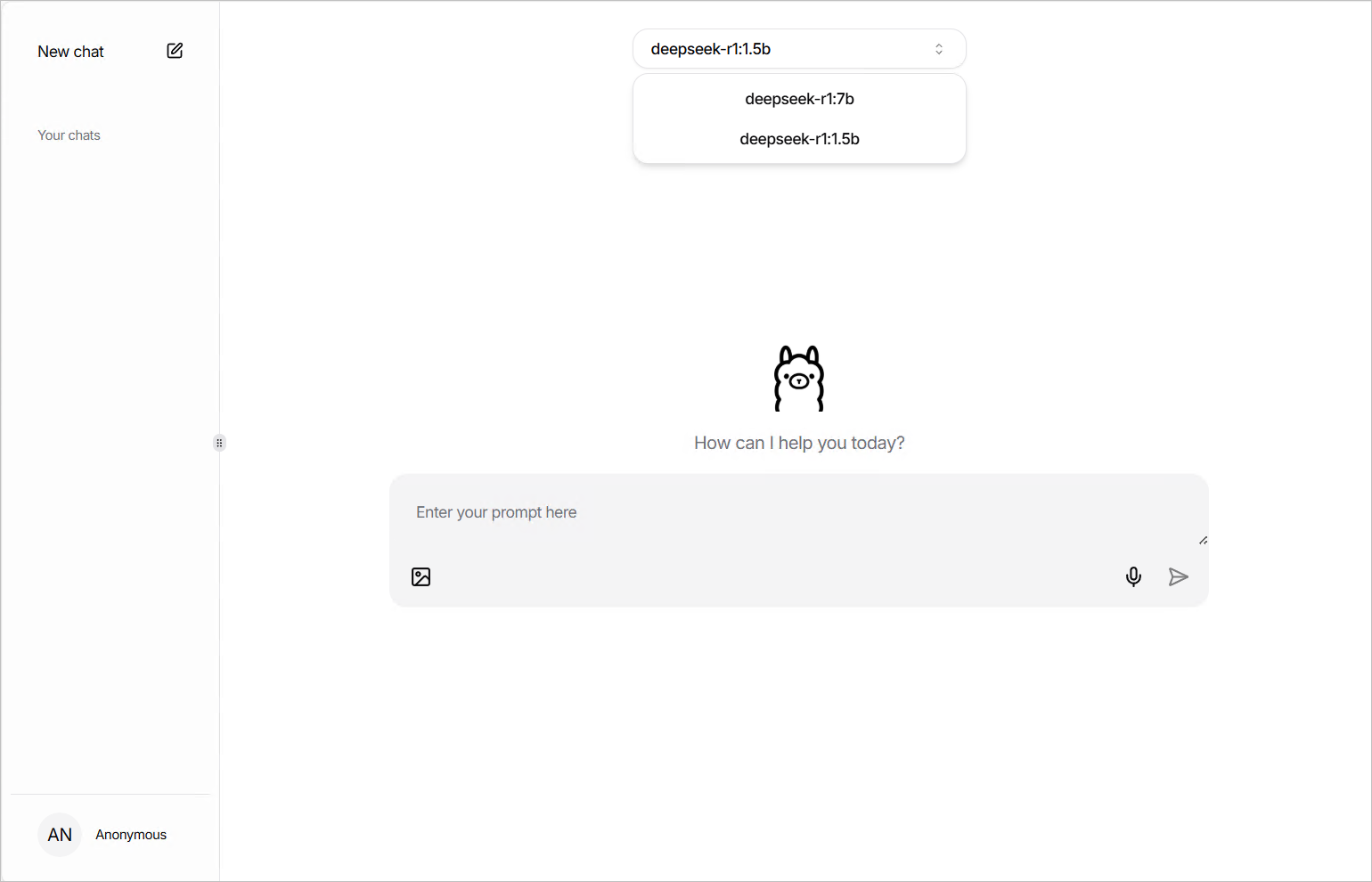

实例启动之后,通过算力连接的 WebUI 按钮打开聊天界面,然后选择内置的 deepseek-r1:1.5b 模型。

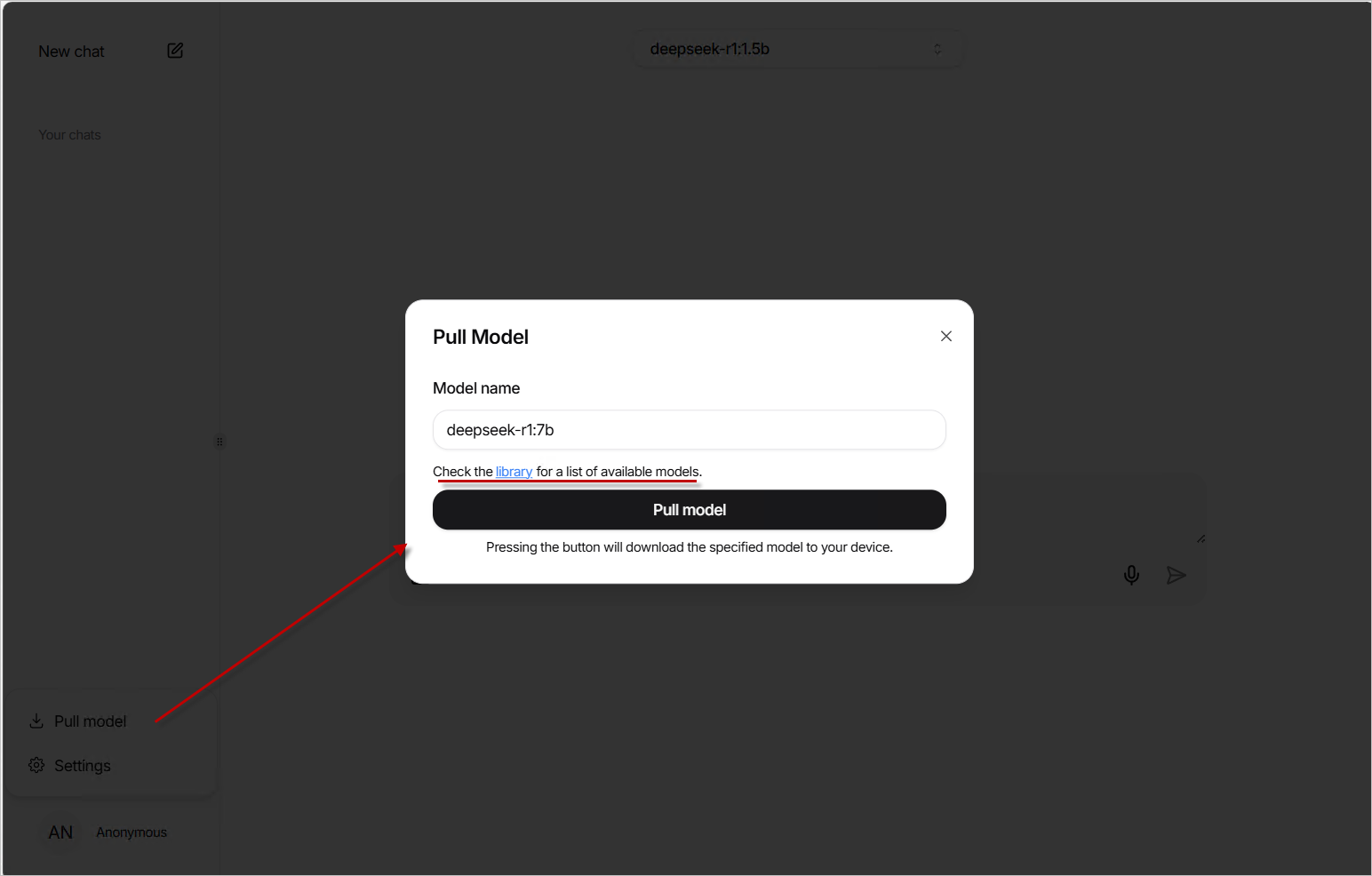

3. (可选)使用其他模型

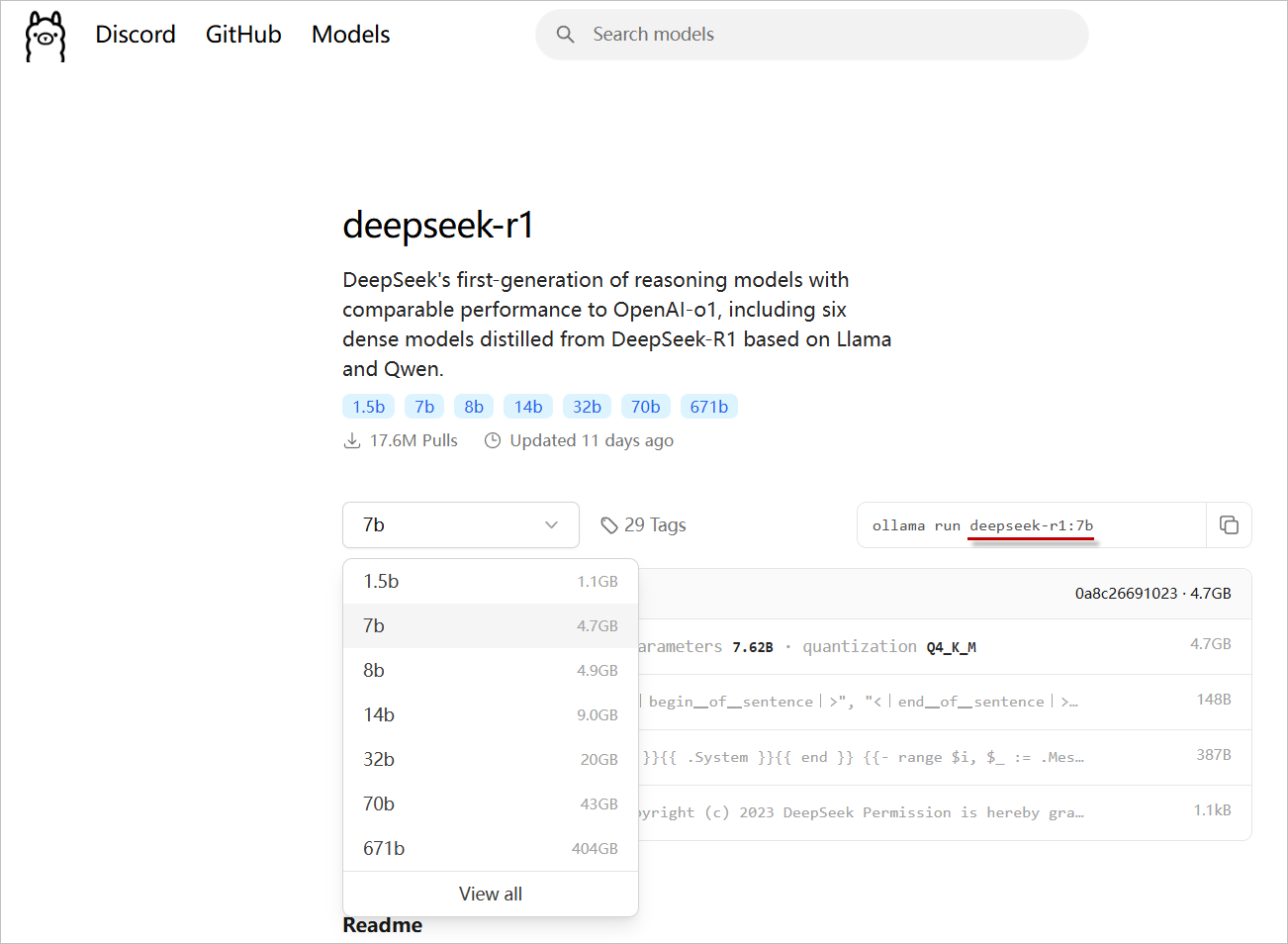

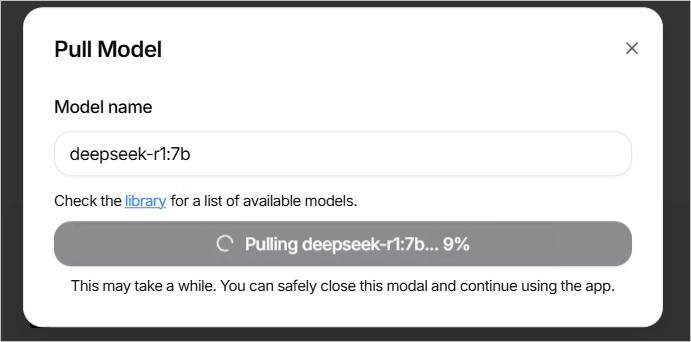

这个模板内置的 WebUI 使用开源项目 https://github.com/jakobhoeg/nextjs-ollama-llm-ui ,支持在线下载其他模型。点击左下角的 pull model 按钮,输入正确的模型名称即可下载使用。

模型名称可以点击 library 查看。(比如下图是 DeepSeek R1 7B 的模型名称)

注意:越大的模型对显存有越高的要求,请根据您的机器/显卡性能谨慎选择。

当完成下载之后,就可以切换模型使用了。

4. 其他使用方式

这个模板还同时提供 Restful API 接口,您可以接入其他支持 Ollama API 的 Web 工具使用,或者直接通过 HTTP 工具调用。

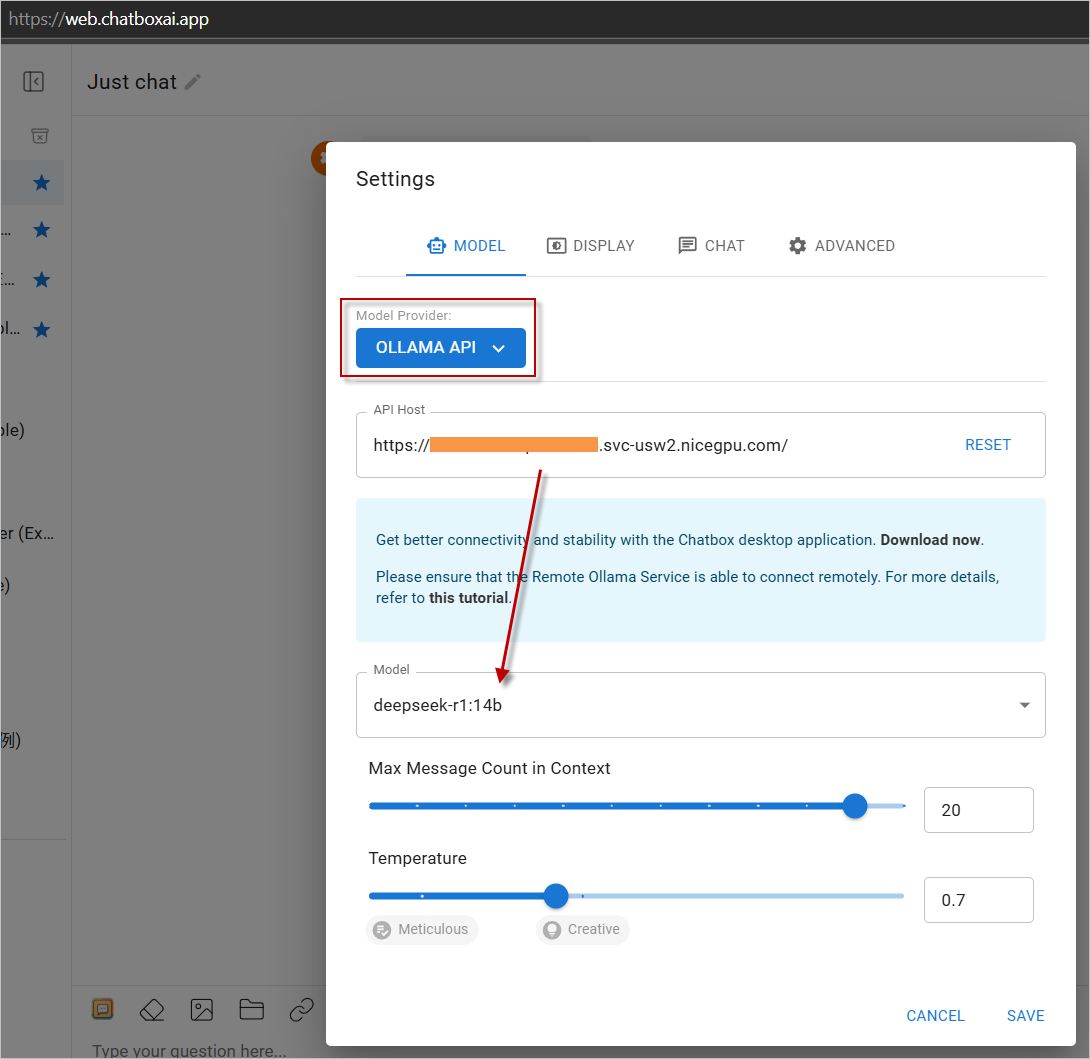

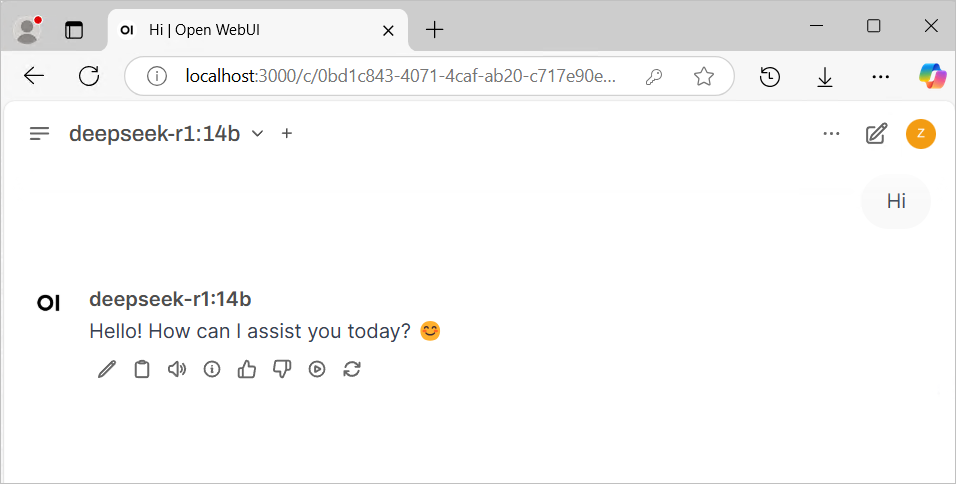

a. 通过 Chatbox 或者 Open Web UI 使用

- 下载主流的大语言模型 Web UI 程序,或者使用 Web 版本。

- 在设置里选择

OLLAMA API作为提供者,然后输入您的实例地址。 - 开始使用吧!

点击 https://web.chatboxai.app 使用 Chatbox Web 版本快速尝试:

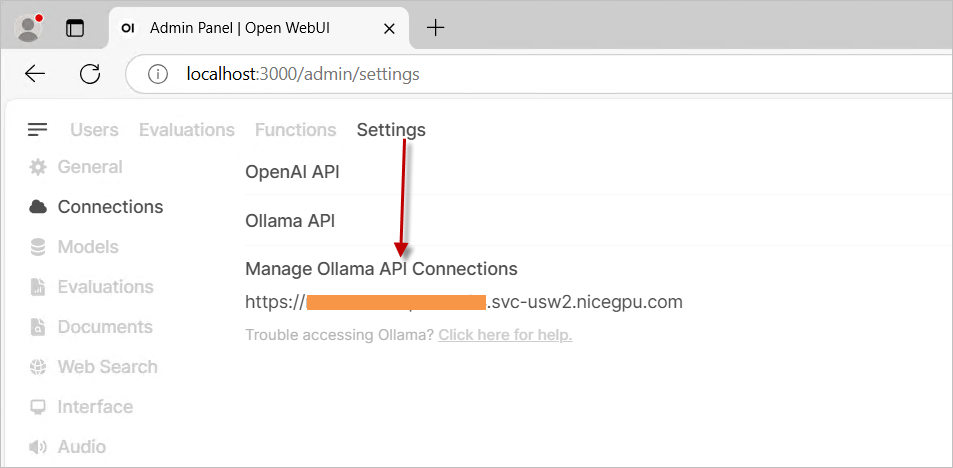

自行安装 OpenWeb UI 程序,在设置里选择 OLLAMA API 作为提供者,并输入您的实例地址。

}width="800"

}width="800"  }{ width="800"

}{ width="800"

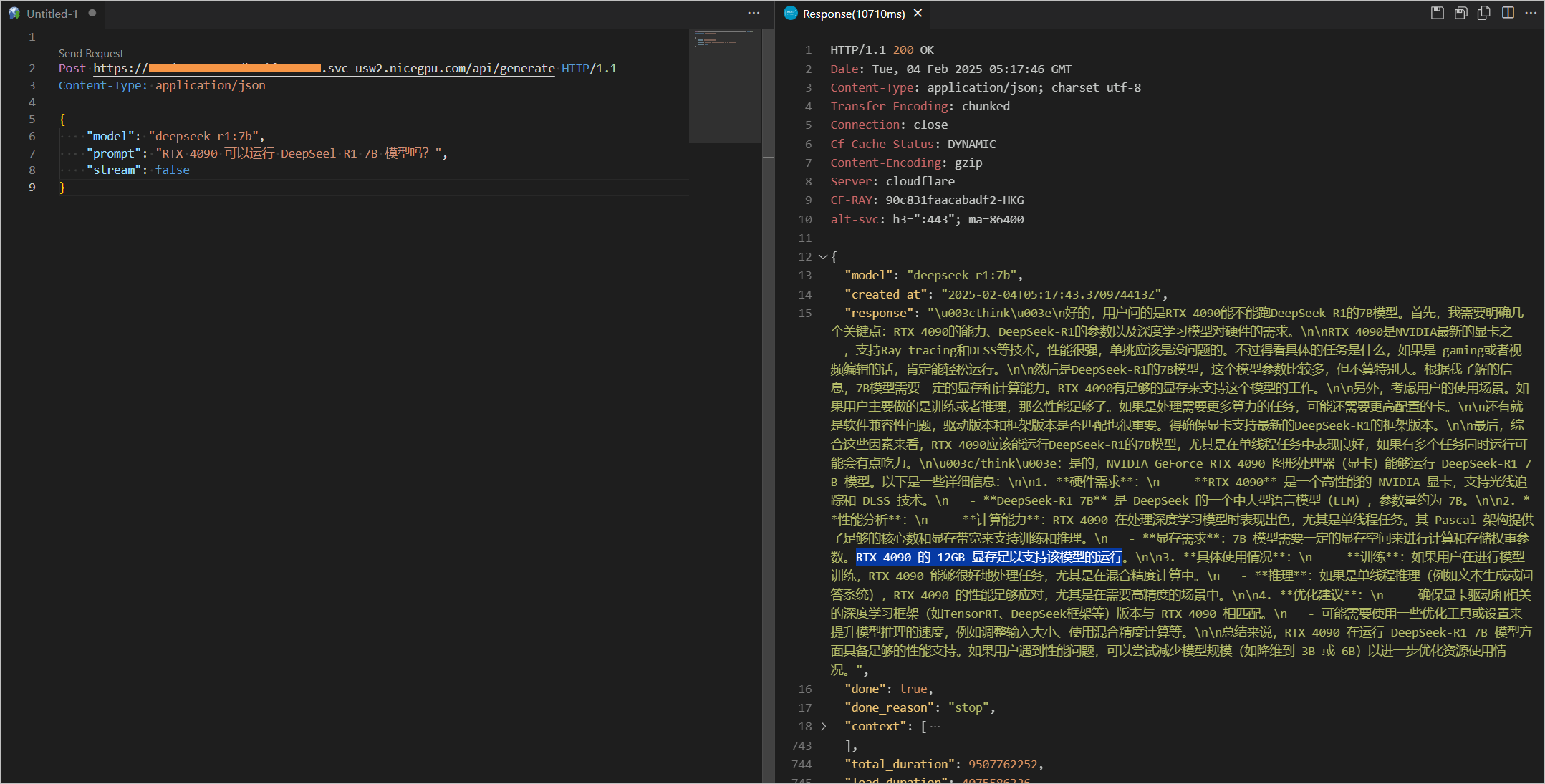

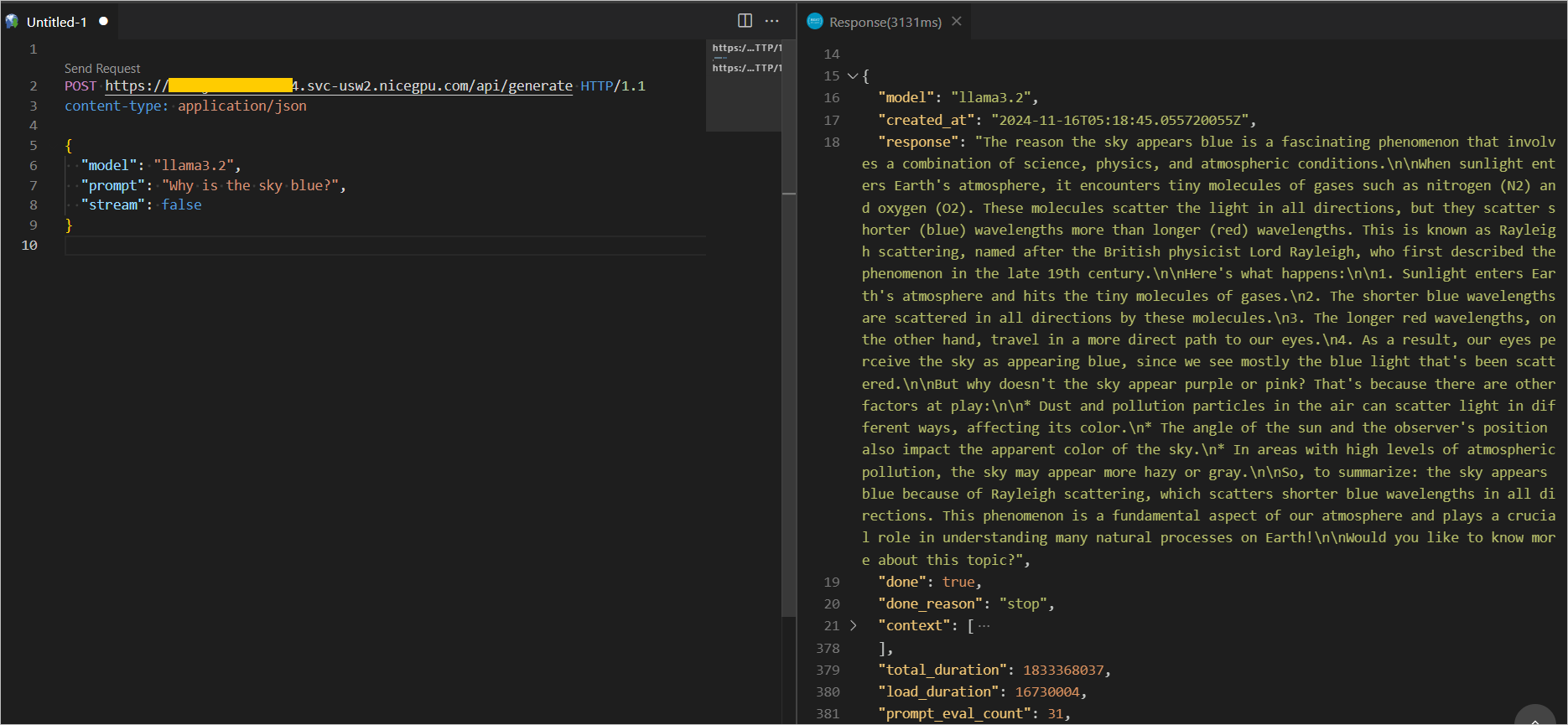

b. 通过 API 直接调用

您也可以直接通过 API 调用,示例如下:

更多 Ollama Restful API 接口和参数请参考官方 REST API 文档

{

"model": "llama3.2",

"prompt": "Why is the sky blue?",

"stream": false

}

{ width="800" }

{ width="800" }

{

"model": "deepseek-r1:7b",

"prompt": "Why is the sky blue?",

"stream": false

}