常见问题(FAQ)

本文档解答使用 NiceGPU 平台时遇到的常见问题,涵盖平台基础信息、实例管理、AI 模型使用和开发环境配置等方面。

目录

基础信息

1. 没有找到需要的模板镜像?

NiceGPU 提供了多种预配置的模板镜像,如果当前模板无法满足您的需求,可以采用以下方式:

- 使用基础镜像:选择

Minimal Notebook基础镜像,然后自行安装所需的环境和依赖包 - 联系支持团队:通过以下渠道联系我们,我们会尽快评估并添加您需要的模板

2. GPU 列表中的"在线数量"表示什么?

在线数量表示该类型 GPU 的总在线数量,包括:

- 已被用户占用的 GPU

- 当前可用的 GPU

该数值不是可用 GPU 的数量。实际可用数量需要根据当前使用情况判断。

3. 不同的 Jupyter Notebook 镜像有什么区别?

NiceGPU 提供的 Jupyter Notebook 镜像均基于 Jupyter Docker Stacks 官方镜像构建,不同镜像预装了不同的软件包和开发环境:

- 基础镜像:仅包含 Jupyter Notebook 核心功能

- 数据科学镜像:预装 NumPy、Pandas、Matplotlib 等数据科学库

- 机器学习镜像:预装 TensorFlow、PyTorch 等深度学习框架

- 其他专业镜像:针对特定领域(如 R、Spark 等)的预配置环境

请根据您的实际需求选择合适的镜像。详细的镜像差异和选择指南,请参考 Jupyter Docker Stacks 官方文档。

平台使用规范

禁止的活动

为保障平台安全性和公平性,NiceGPU 严格禁止以下活动:

- 加密货币挖矿:禁止使用平台资源进行加密货币挖矿

- 密码破解:禁止进行密码暴力破解或字典攻击

- 拒绝服务攻击(DDoS):禁止发起或参与任何形式的网络攻击

- P2P 文件共享和种子下载:禁止使用 BitTorrent 等 P2P 协议

- 远程代理连接:禁止将实例用作代理服务器或 VPN 节点

- 多账号规避限制:禁止通过多个账号规避平台使用限制

- 深度伪造(Deepfake):禁止使用平台资源生成深度伪造内容

- 技术规避反滥用策略:禁止通过技术手段规避平台的安全和反滥用机制

违反上述规定的账号将被暂停或永久封禁,请合理使用平台资源。

实例管理

1. 是否可以使用 Docker 或运行自定义镜像?

不支持。出于安全性和稳定性考虑,NiceGPU 平台:

- 不支持运行 Docker:实例运行在容器环境中,无法嵌套运行 Docker

- 不支持自定义镜像:仅能使用平台提供的预配置模板镜像

如需特定的软件环境,请使用 Minimal Notebook 基础镜像自行安装配置。

2. 实例过期后无法启动?

是的。实例过期后无法启动,需要先完成续费操作。

续费后,实例将恢复正常状态,您可以继续使用。

3. 创建实例后能否修改配置?

不支持。实例创建后,以下配置无法修改:

- GPU 型号和数量

- 内存大小

- 存储空间

- 其他硬件配置

如需使用不同的配置,请:

- 删除当前实例(如已保存重要数据,请先备份)

- 使用新配置重新创建实例

4. 创建实例时报错:Container not found

原因:宿主机出现异常,无法创建容器实例。

解决方案:

- 删除当前失败的实例

- 重新创建实例

- 如问题持续,请联系技术支持:support@nicegpu.com

5. 创建实例时报错:Out of memory

原因:您选择的模板镜像对 GPU 显存(VRAM)要求较高,当前宿主机显存不足。

解决方案:

- 删除当前失败的实例

- 选择显存更大的 GPU 型号

- 重新创建实例

建议:创建实例前,请确认所选模板的显存需求,选择合适规格的 GPU。

6. 实例创建完成后如何使用?

实例创建成功后会自动启动,使用步骤如下:

- 确认实例状态:在实例列表中,状态列应显示为

Running - 访问服务:在算力连接列中,点击对应的服务链接地址

- 开始使用:根据模板类型,您将看到:

- Jupyter Notebook:Web IDE 界面

- AI 模型服务:API 端点或 Web UI

- 其他服务:对应的访问界面

AI 模型使用

1. 如何使用 DeepSeek 模型?

NiceGPU 支持以下 DeepSeek 模型:

- DeepSeek R1:1.5B、8B、14B

- DeepSeek Code V2:16B

使用方法:

- Web 界面使用:参考 Chat with DeepSeek

- API 调用:参考 How to use DeepSeek-R1, Llama

2. AI 模型支持上传图片吗?

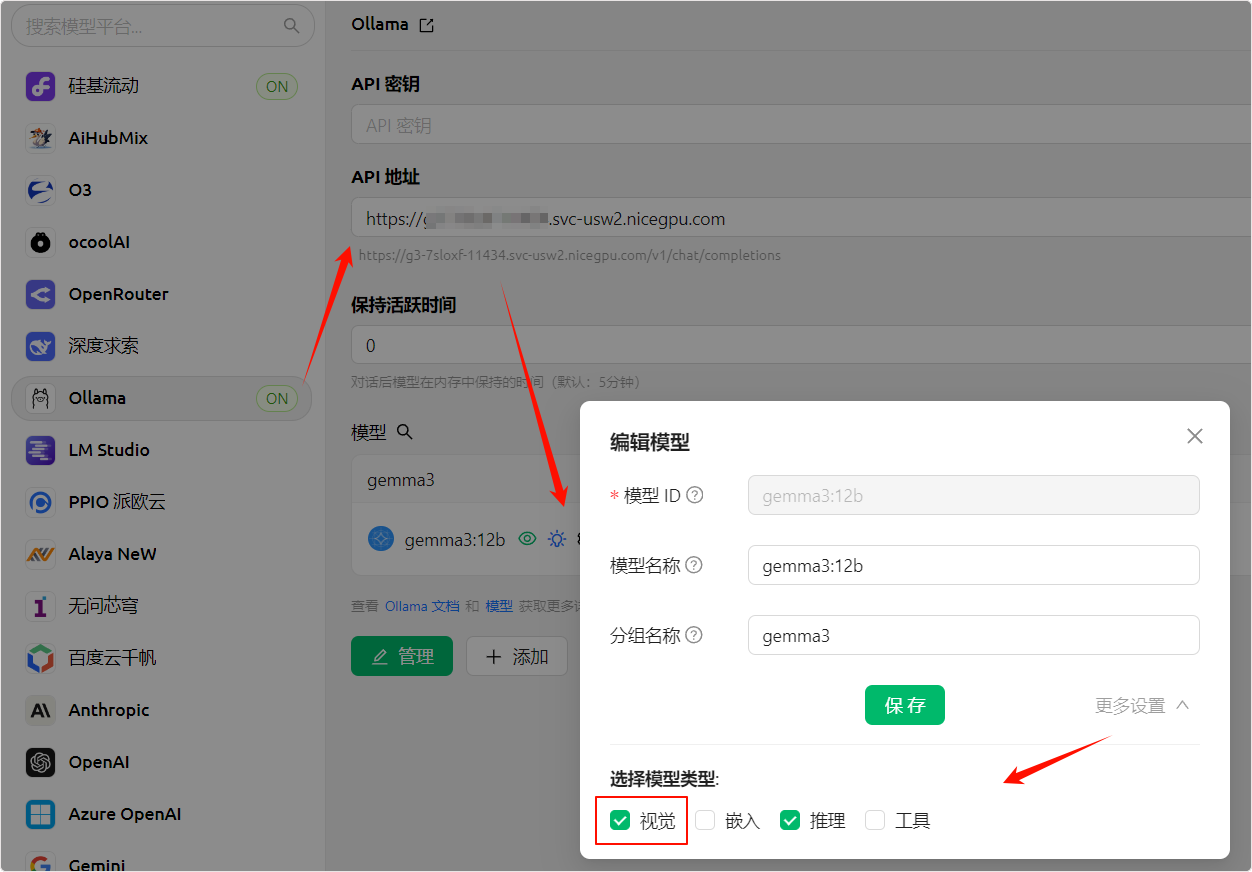

部分支持。Ollama 框架中的部分模型支持多模态(Vision)功能,可以处理图片输入。

支持的模型:

Llama 11B(Vision 版本)Gemma3 12B(Vision 版本)

使用方法:

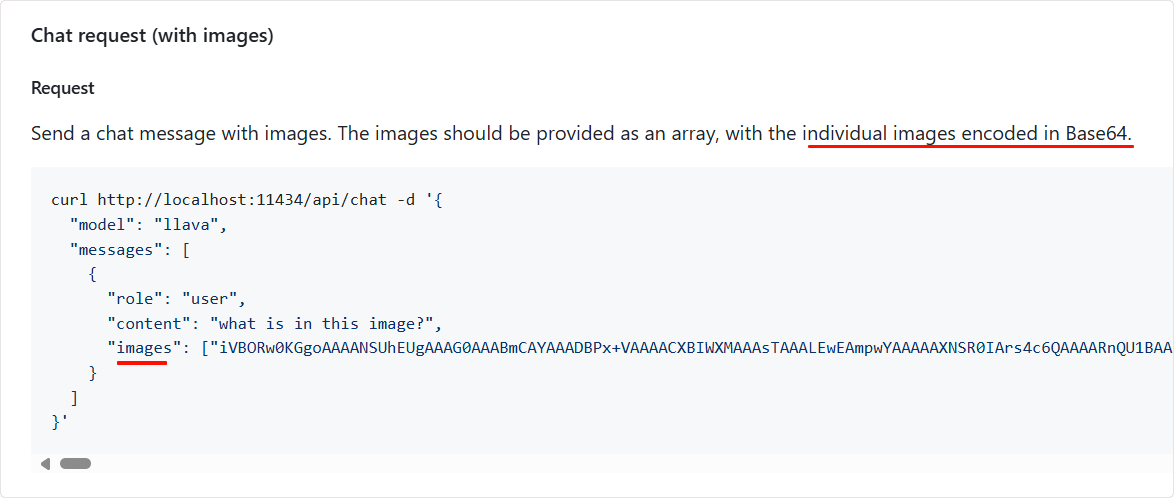

方法一:API 调用

在 API 请求中添加 Base64 编码的图片数据。详细说明请参考 Ollama 官方 API 文档。

方法二:使用支持 Vision 的 UI 工具

可以使用支持 Ollama API 图片上传功能的第三方 UI 工具,例如:

- Cherry AI:支持 Vision 功能(推荐)

- 不支持的工具:

在支持 Vision 的 UI 工具中,您可以在聊天输入框中直接上传图片。

3. 打开 DeepSeek API 服务时显示 "Ollama is running"?

这是正常现象。NiceGPU 通过 Ollama 框架加载和运行 DeepSeek 模型,因此:

- 状态显示:服务状态会显示为 "Ollama is running"

- API 调用方式:需要按照 Ollama API 规范 进行调用

DeepSeek 模型已集成到 Ollama 框架中,您可以使用标准的 Ollama API 与 DeepSeek 模型交互。

开发环境配置

1. Jupyter Notebook 上传文件超过 100MB 报错?

原因:Jupyter Notebook 的默认配置限制了上传文件大小为 100MB。

解决方案:

不建议修改限制

出于安全性和性能考虑,我们不建议修改此限制。

推荐做法:

- 使用云存储:将大文件上传到第三方云存储服务(如 Google Drive、Dropbox、OneDrive 等)

- 通过下载使用:在 Jupyter Notebook 中使用

wget或curl命令下载文件 - 使用 Git LFS:对于代码仓库中的大文件,使用 Git LFS 管理

示例:

# 使用 wget 下载文件

!wget https://example.com/large-file.zip

# 或使用 Python requests

import requests

url = "https://example.com/large-file.zip"

response = requests.get(url, stream=True)

with open("large-file.zip", "wb") as f:

for chunk in response.iter_content(chunk_size=8192):

f.write(chunk)

2. 没有 systemctl 命令?

原因:NiceGPU 实例运行在容器环境中,不是传统的云虚拟主机。

说明:

- 容器环境不支持

systemctl、service等系统服务管理命令 - 容器内的进程由容器运行时直接管理

- 如需管理后台服务,请使用其他方式(如

nohup、screen、tmux等)

替代方案:

# 使用 nohup 在后台运行服务

nohup python app.py &

# 使用 screen 管理会话

screen -S mysession

python app.py

# 按 Ctrl+A 然后 D 退出,使用 screen -r mysession 恢复

# 使用 tmux 管理会话

tmux new -s mysession

python app.py

# 按 Ctrl+B 然后 D 退出,使用 tmux attach -t mysession 恢复

3. 如何安装 CUDA Toolkit?

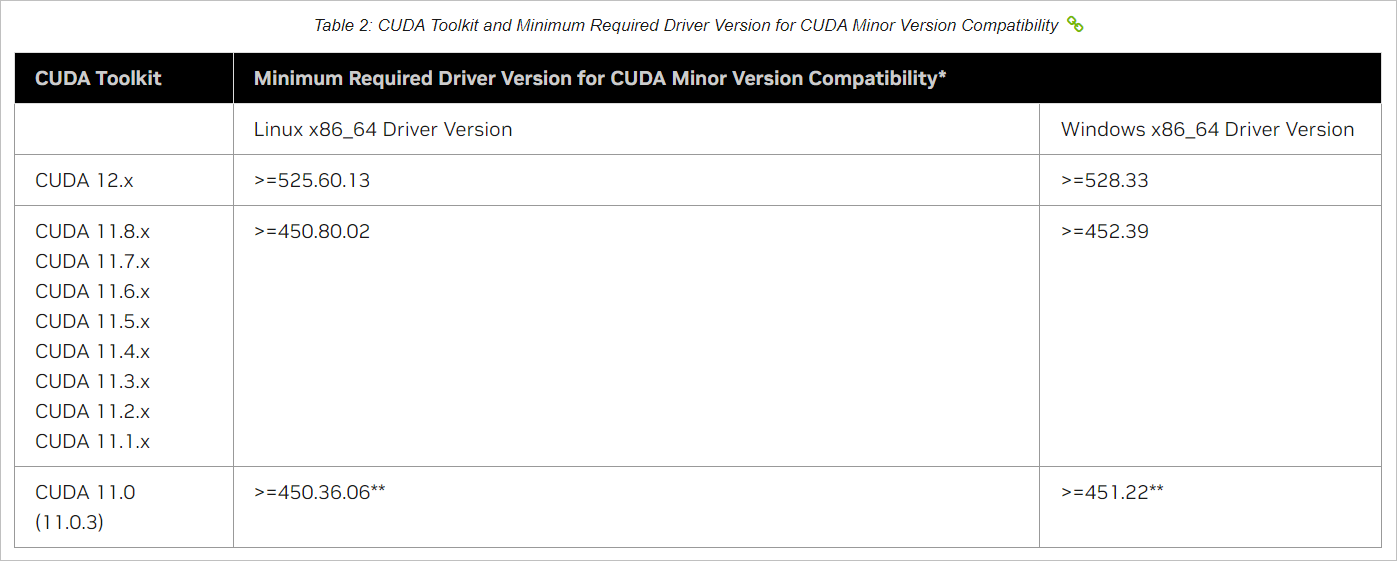

CUDA Toolkit 是 NVIDIA GPU 开发的必要工具。安装前需要确认驱动版本兼容性。

安装步骤:

- 确认驱动版本:使用

nvidia-smi命令查看当前 NVIDIA 驱动版本

nvidia-smi

- 查看兼容性:参考 NVIDIA CUDA Toolkit 版本兼容性文档,确认驱动版本支持的 CUDA Toolkit 版本

- 下载并安装:根据操作系统版本,从 NVIDIA 官方下载页面 下载对应的 CUDA Toolkit

以 Ubuntu 为例

其他操作系统,请参考 https://developer.nvidia.com/cuda-downloads 进行安装。

重要提示:如果您在 Jupyter Notebook 中安装 CUDA Toolkit,安装完成后需要 重启 Kernel(Kernel → Restart Kernel)以确保新的环境变量生效。

# 添加 NVIDIA CUDA 仓库密钥

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

# 更新软件包列表

sudo apt-get update

# 安装 CUDA Toolkit 12.6

sudo apt-get -y install cuda-toolkit-12-6

# 验证安装

/usr/local/cuda-12/bin/nvcc --version

# 添加 NVIDIA CUDA 仓库密钥

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2404/x86_64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

# 更新软件包列表

sudo apt-get update

# 安装 CUDA Toolkit 12.8

sudo apt-get -y install cuda-toolkit-12-8

# 验证安装

/usr/local/cuda-12/bin/nvcc --version

验证安装:

安装完成后,使用以下命令验证 CUDA Toolkit 是否正确安装:

# 检查 CUDA 编译器版本

/usr/local/cuda-12/bin/nvcc --version

# 检查 CUDA 运行时版本

python -c "import torch; print(torch.version.cuda)"

获取帮助

如果您的问题未在本文档中找到答案,请通过以下方式联系我们:

- 邮箱支持:support@nicegpu.com

- Reddit 社区:https://www.reddit.com/r/nicegpu/

我们会尽快回复您的问题。